Déployer des ressources

Concept

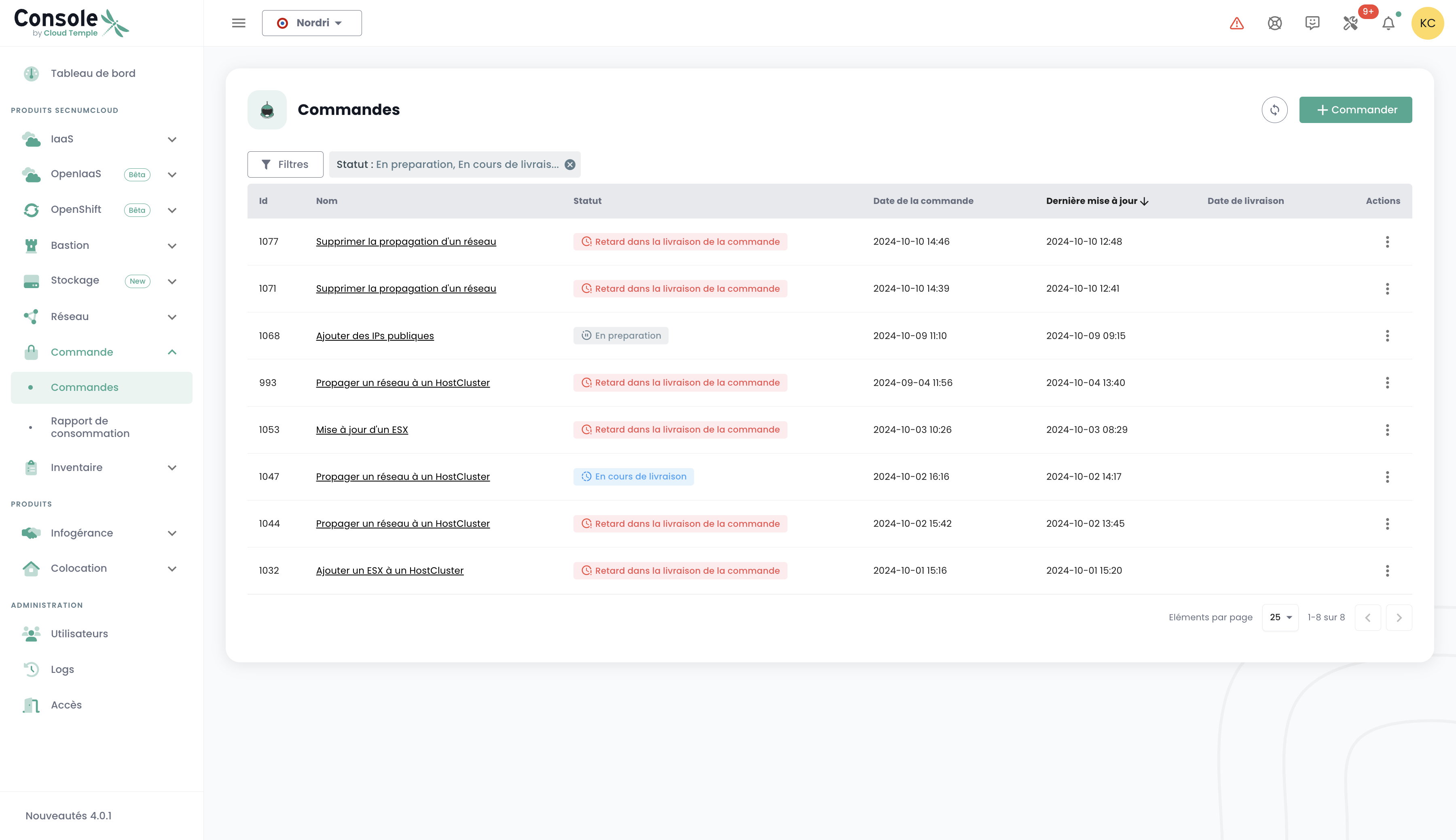

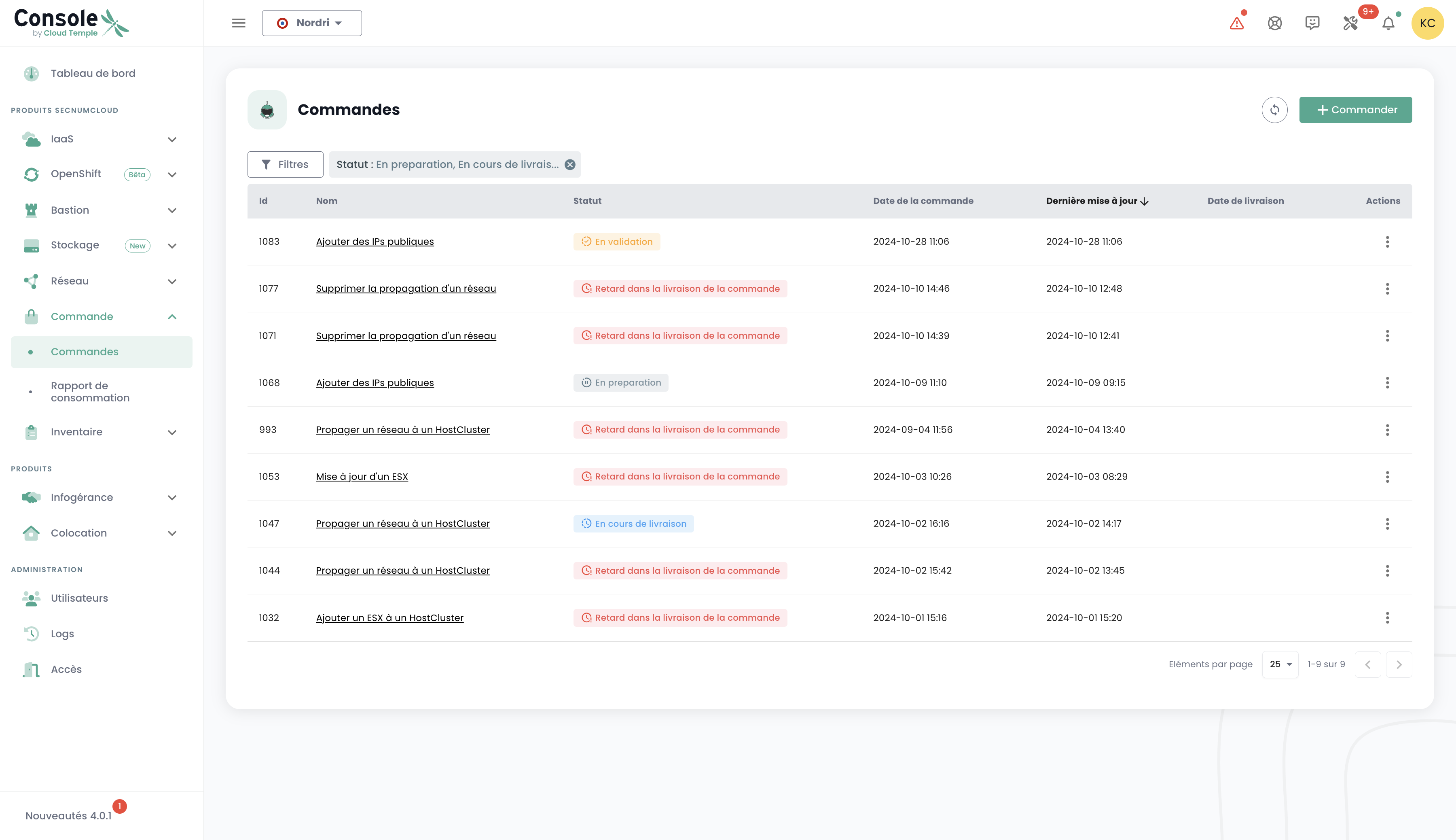

Le suivi du déploiement de nouvelles ressources se fait dans le menu 'Commandes' accessible dans le bandeau vert à gauche de l'écran.

Il permet de visualiser les ressources Cloud commandées, en cours de déploiement et les eventuelles erreurs au sein d'un Tenant de votre Organisation.

Nota : A cet instant, la vue globale au niveau d'une organisation de l'ensemble des ressources déployées dans les différents tenants n'est pas encore possible. Ce sujet sera traité ultérieurement par la mise en œuvre d'un portail dédié au commanditaire (au sens signataire) et au pilotage de son organisation.

Le déploiement des ressources ou leur suppression se font dans chacun des produits dans les menus 'IaaS' et 'Réseau' à gauche de l'écran dans le bandeau vert.

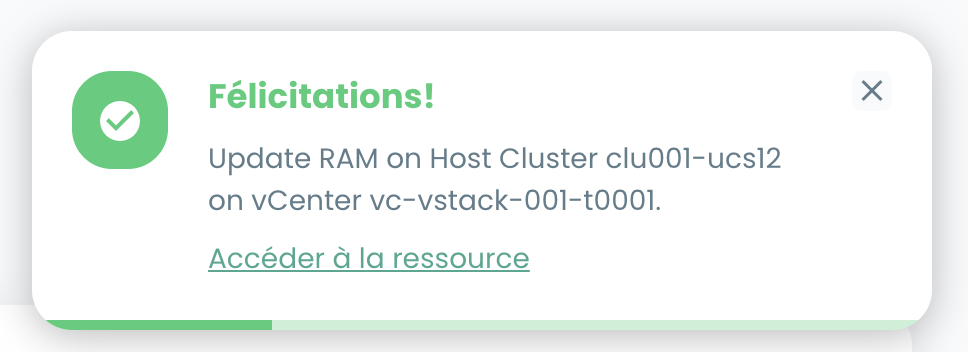

Il est aussi possible de voir directement les livraisons au niveau des notifications de la console Cloud Temple :

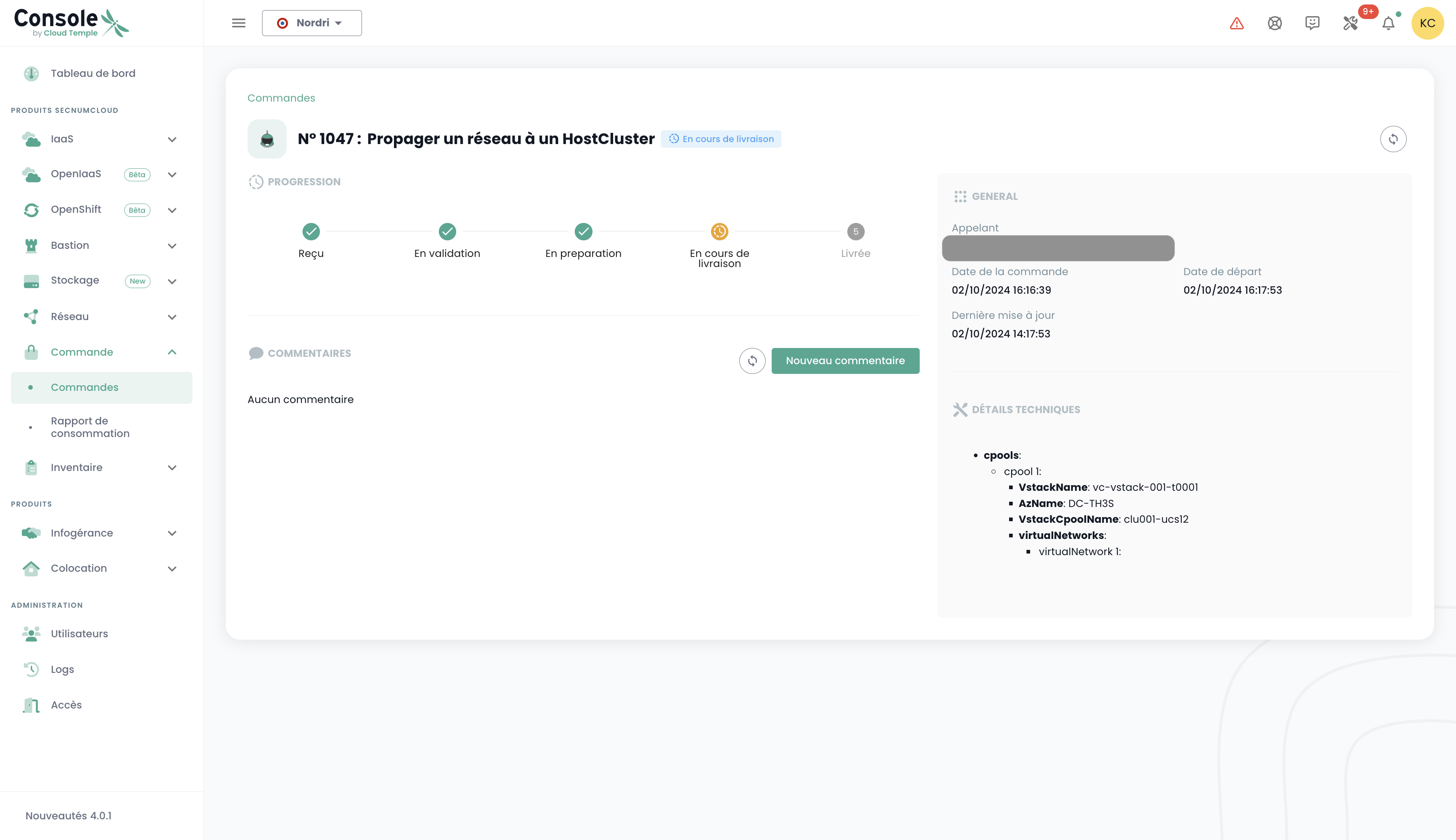

Depuis la page de commandes, vous pouvez voir l'état d'avancement d'une livraison et éventuellement dialoguer avec l'équipe en apportant des commentaires ou des précisions :

Note : Il n'est pas possible de lancer plusieurs commandes du même type de ressource simultanément. Vous devrez donc attendre que la commande en cours soit traitée et finalisée avant de pouvoir en effectuer une nouvelle. Cela garantit une gestion efficace et ordonnée des ressources au sein de votre environnement.

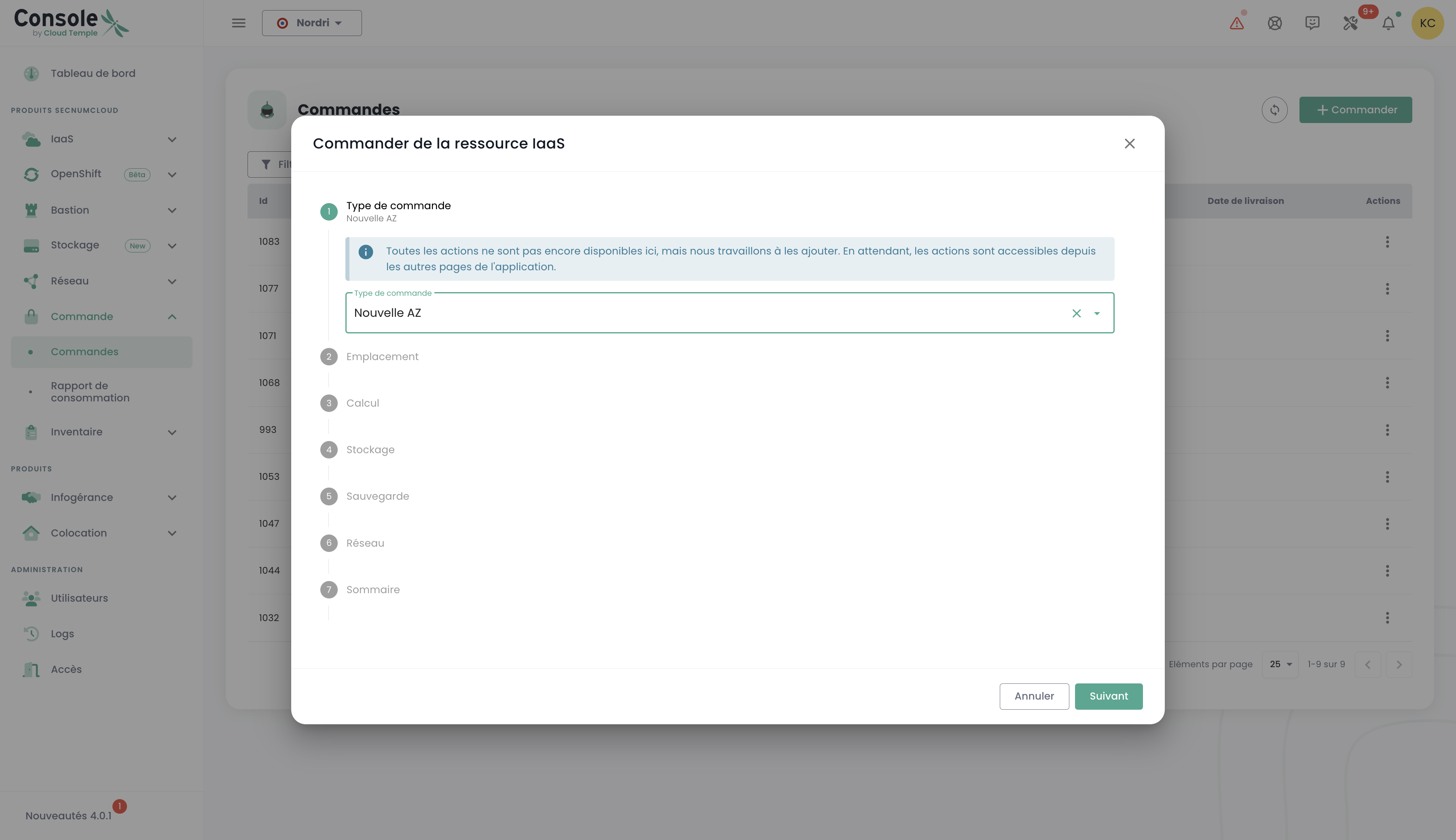

Commander une nouvelle zone de disponibilité

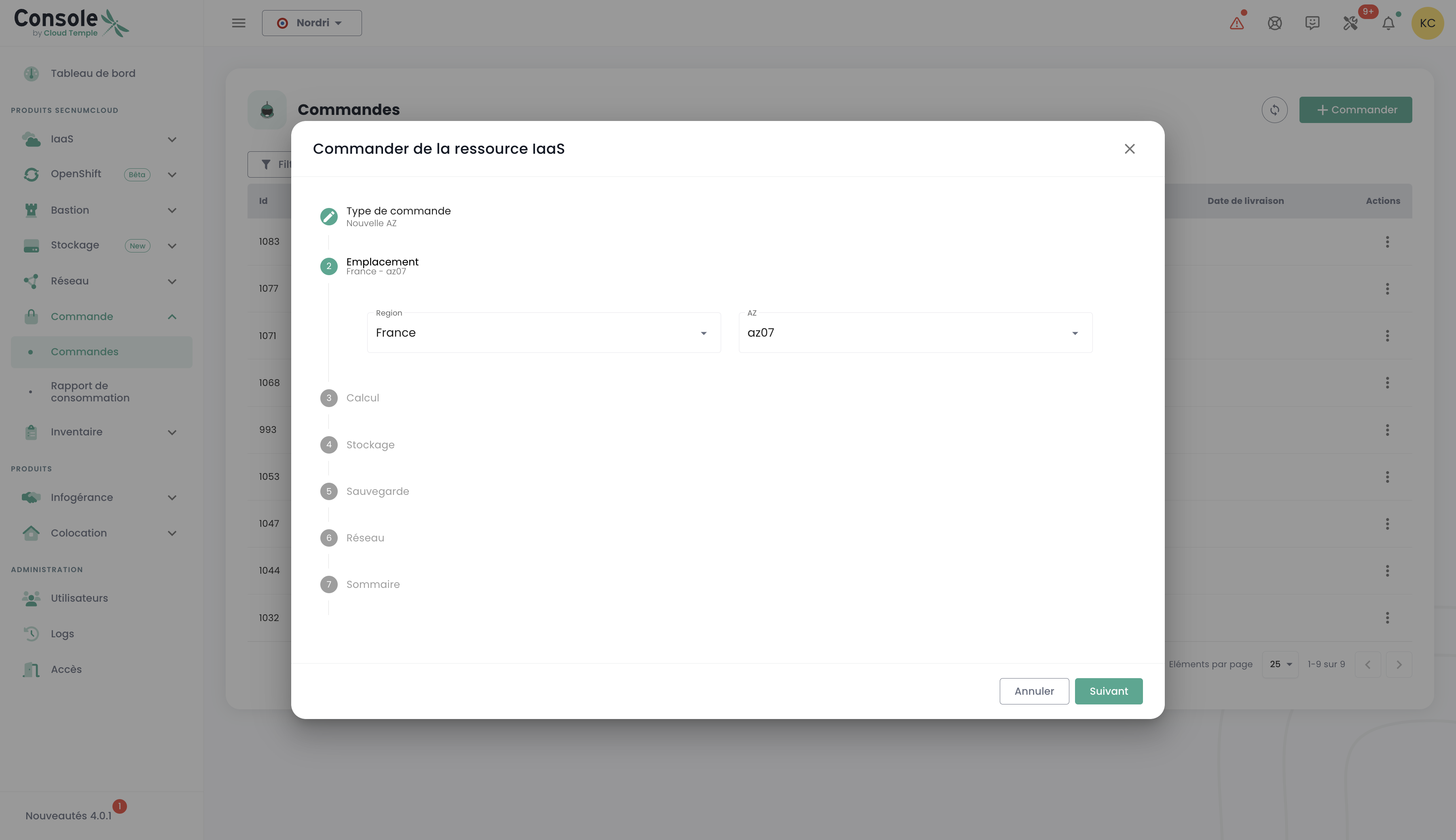

Il est possible d'ajouter une nouvelle zone de disponibilité en accédant au menu "Commande". Cette option vous permet d'étendre vos ressources et d'améliorer la disponibilité et la résilience de vos applications en quelques clics seulement :

On commence par sélectionner l'emplacement souhaité, en choisissant d'abord la région géographique, puis la zone de disponibilité (AZ) correspondante parmi celles qui sont disponibles. Cette étape permet d'adapter le déploiement de vos ressources en fonction de la localisation et des exigences de votre infrastructure :

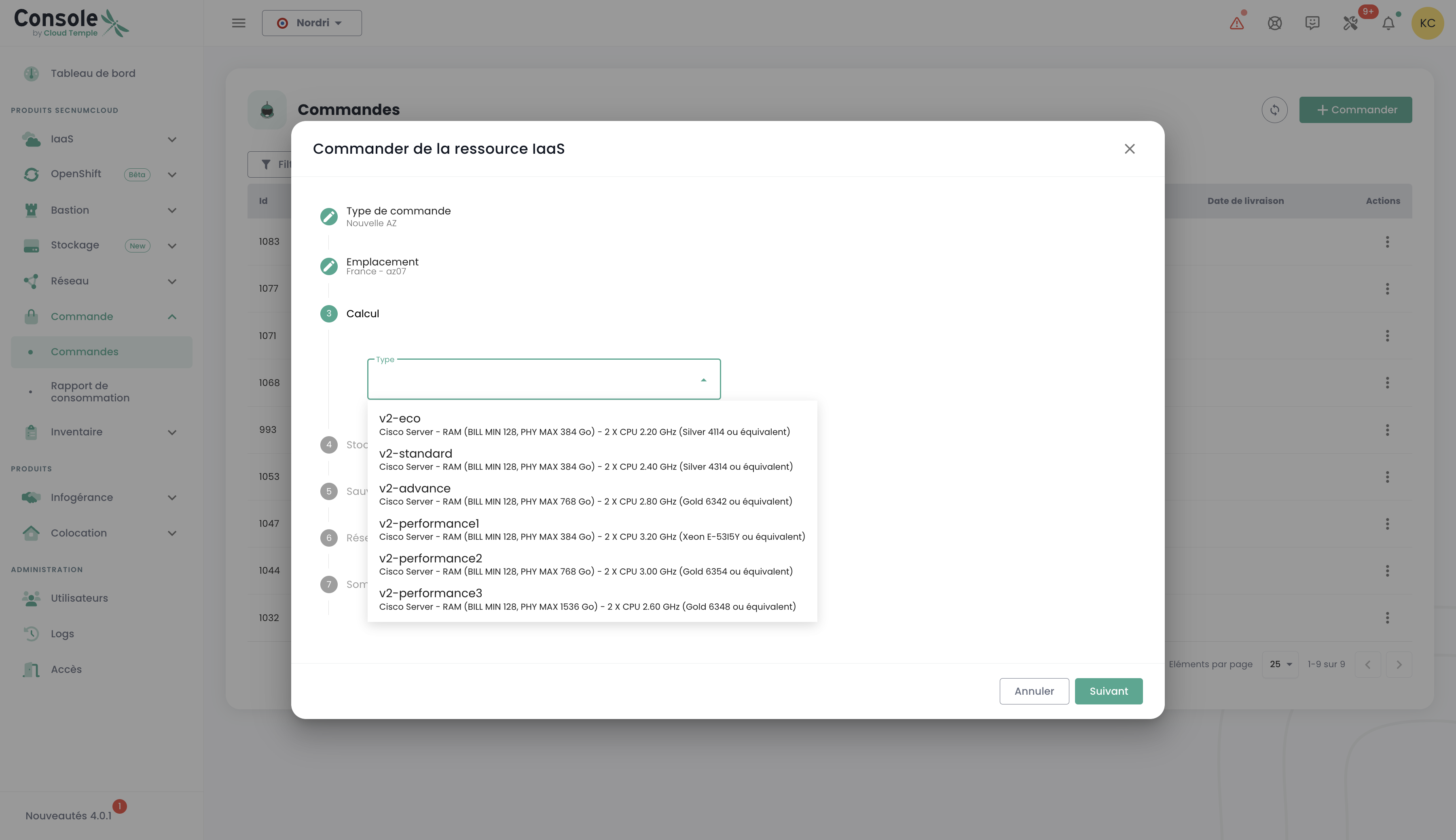

Ensuite, procédez à la sélection du type de cluster d'hyperviseur désiré, en choisissant celui qui répond le mieux aux besoins de performance et de gestion de votre infrastructure cloud :

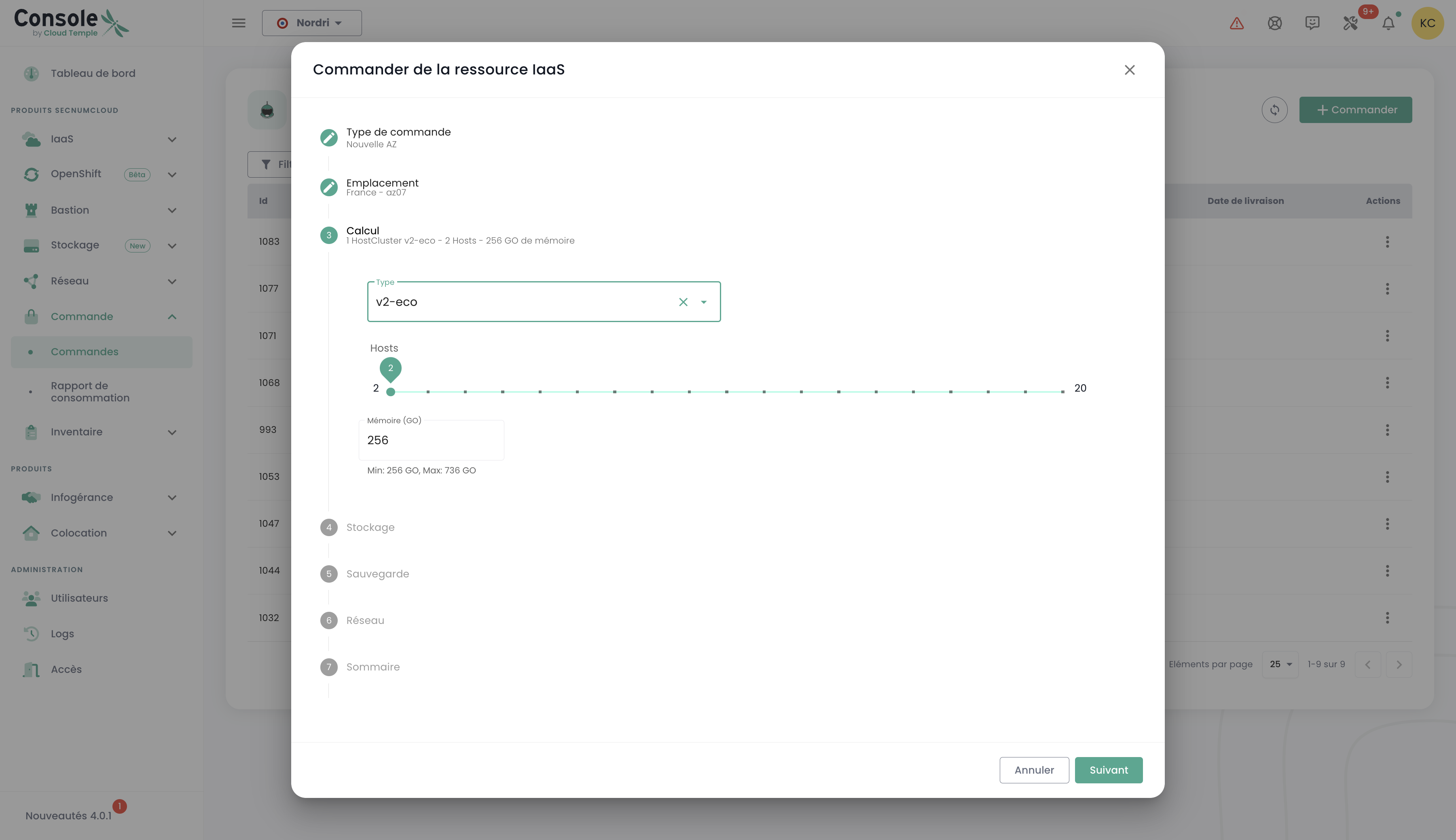

Sélectionnez ensuite le nombre d'hyperviseurs ainsi que la quantité de mémoire souhaitée, afin d'adapter les ressources à la charge de travail et aux exigences spécifiques de votre environnement cloud :

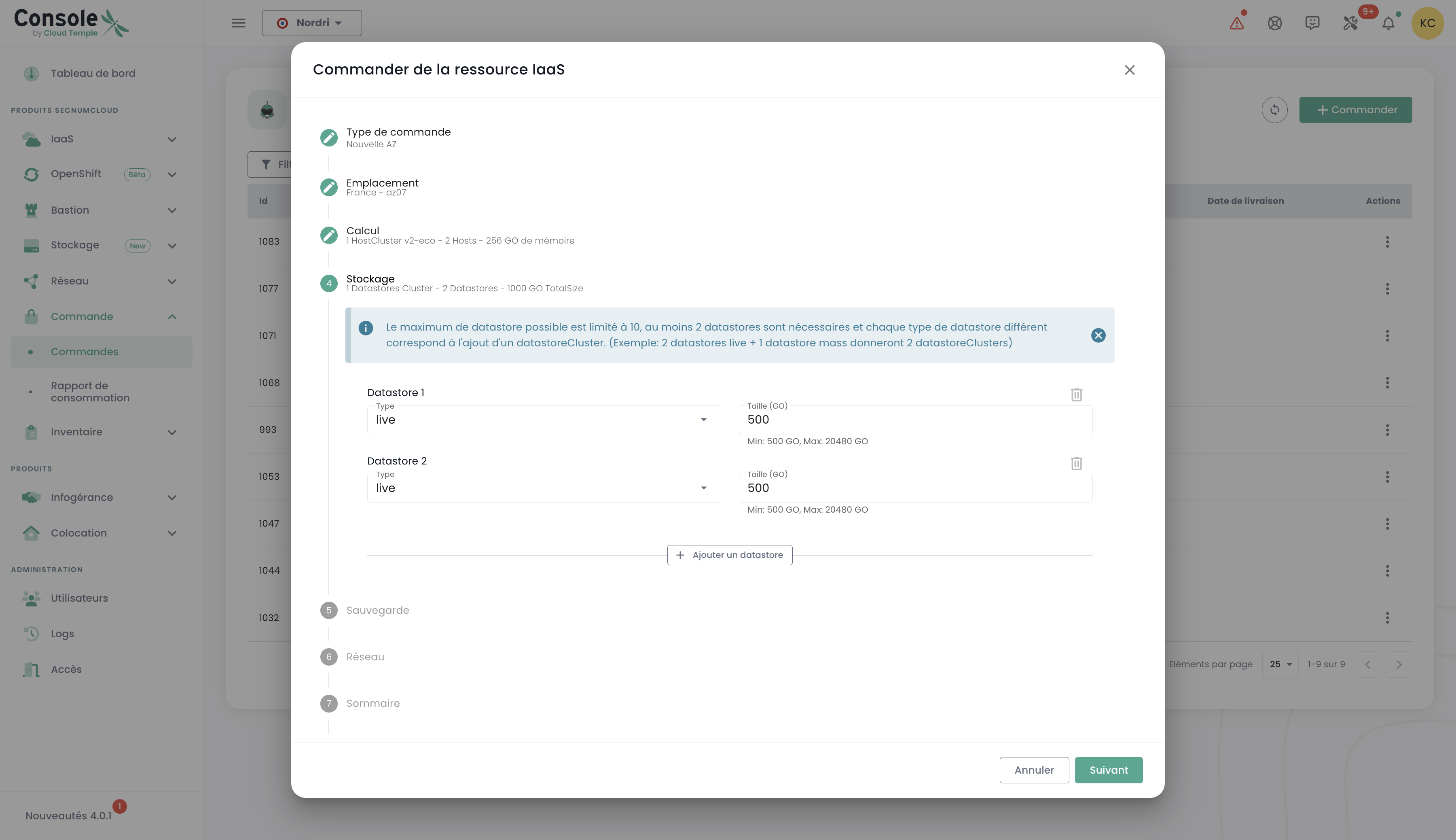

Sélectionnez ensuite le nombre de datastores à provisionner dans le cluster ainsi que leurs types. Il est important de noter que le nombre maximum de datastores autorisé est de 10, avec un minimum de 2 datastores requis. Chaque type de datastore différent entraînera la création d'un datastoreCluster supplémentaire. Par exemple, si vous choisissez 2 datastores de type "live" et 1 datastore de type "mass", cela aboutira à la formation de 2 datastoreClusters distincts :

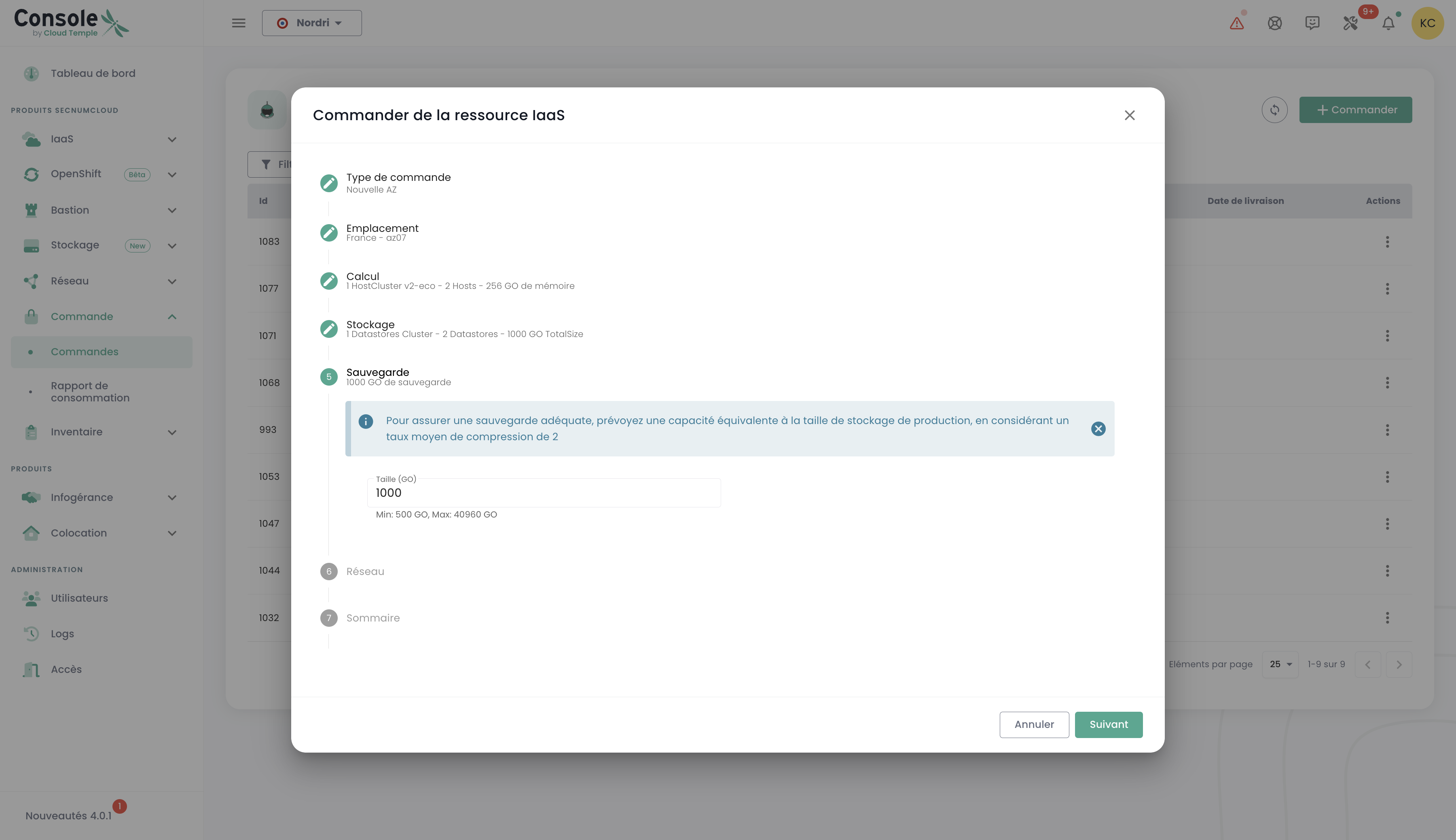

Définissez la taille de stockage nécessaire pour la sauvegarde en veillant à prévoir une capacité équivalente à celle de votre stockage de production. Tenez compte d'un taux de compression moyen de 2 afin d'optimiser l'espace de sauvegarde et d'assurer une protection efficace de vos données:

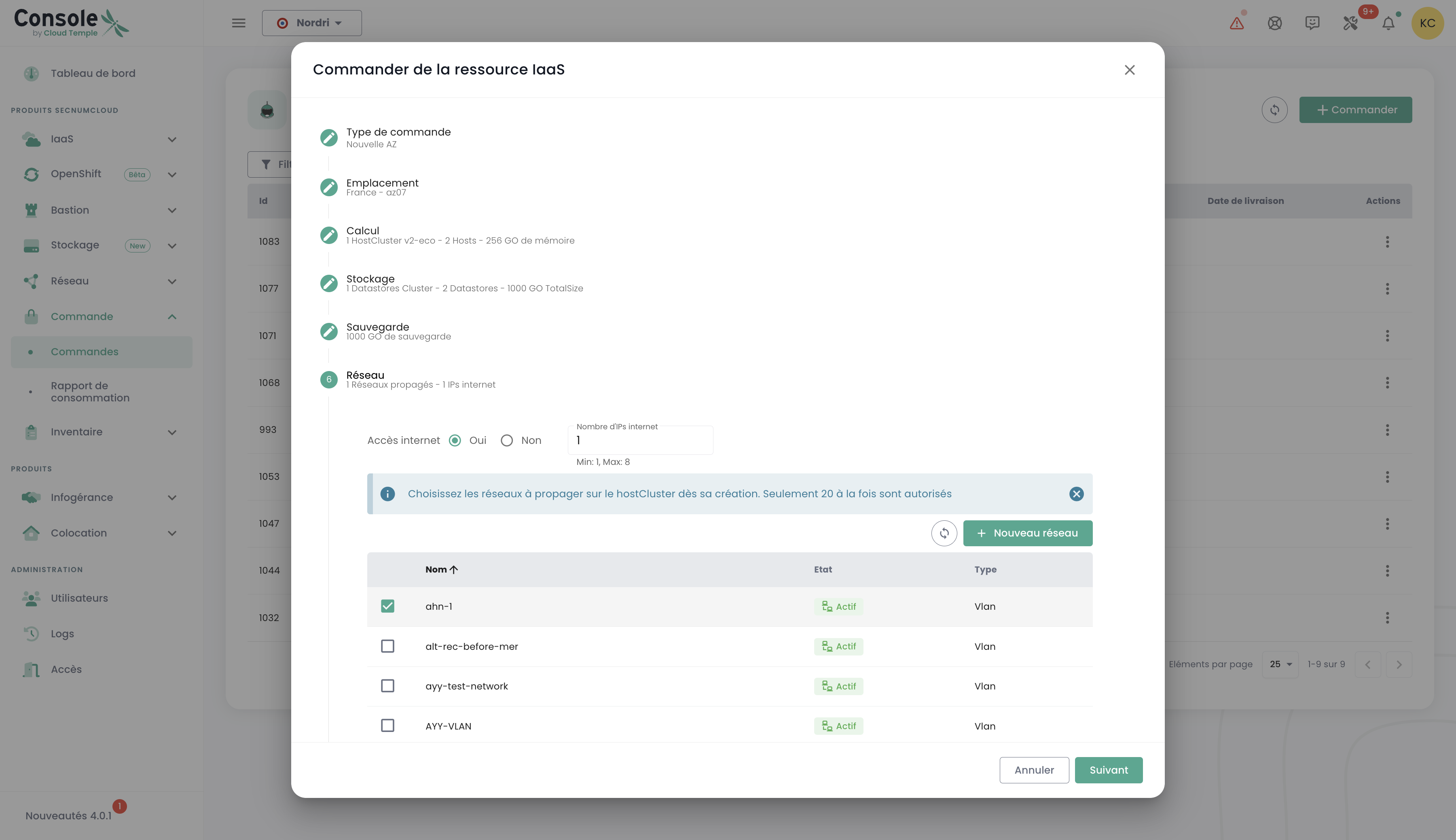

Sélectionnez les réseaux à propager en fonction de vos besoins. Vous avez également la possibilité d'activer l'option "Accès internet" si nécessaire, en définissant le nombre d'adresses IP souhaitées, avec un choix compris entre 1 et un maximum de 8:

Vous obtenez ensuite un résumé des options sélectionnées avant de valider votre commande.

Commander de la ressource stockage supplémentaire

La logique d'allocation du stockage en mode bloc sur les clusters de calcul repose sur la technologie IBM SVC (San Volume Controller) et IBM FlashSystem. Le stockage est organisé en LUNs de 500 Gio minimum, présentées selon la technologie utilisée :

- Pour VMware : sous forme de datastores regroupés dans des clusters SDRS (Storage Distributed Resource Scheduler)

- Pour Bare Metal : sous forme de volumes

- Pour Open IaaS : sous forme de Storage Repository (SR)

Chaque datastore hérite d'une classe de performance définie en IOPS/To (de 500 à 15000 IOPS/To pour le FLASH, ou sans garantie pour le MASS STORAGE). La limitation d'IOPS est appliquée au niveau du datastore (et non par VM), ce qui signifie que toutes les machines virtuelles partageant le même datastore se partagent le quota d'IOPS alloué.

Points clés à retenir :

- Taille minimale : 500 Gio par LUN

- Performance : Proportionnelle au volume alloué, dans la limite d'un plafond physique absolu par LUN (ex: 2 To en classe Standard = 3000 IOPS, mais une LUN de 10 To plafonnera à 30 000 IOPS maximum). Ce plafond varie selon la classe (10 000 IOPS / 512 Mo/s pour la classe Essentiel, et 30 000 IOPS / 1024 Mo/s pour les classes supérieures).

- Organisation : Les datastores de même type sont automatiquement regroupés en clusters de datastores

- Disponibilité : 99,99% mesuré mensuellement, plages de maintenance incluses

- Espace nécessaire : Prévoir toujours 10% d'espace libre pour les snapshots de sauvegarde et l'équivalent de la somme des RAM des VMs pour les fichiers .VSWP

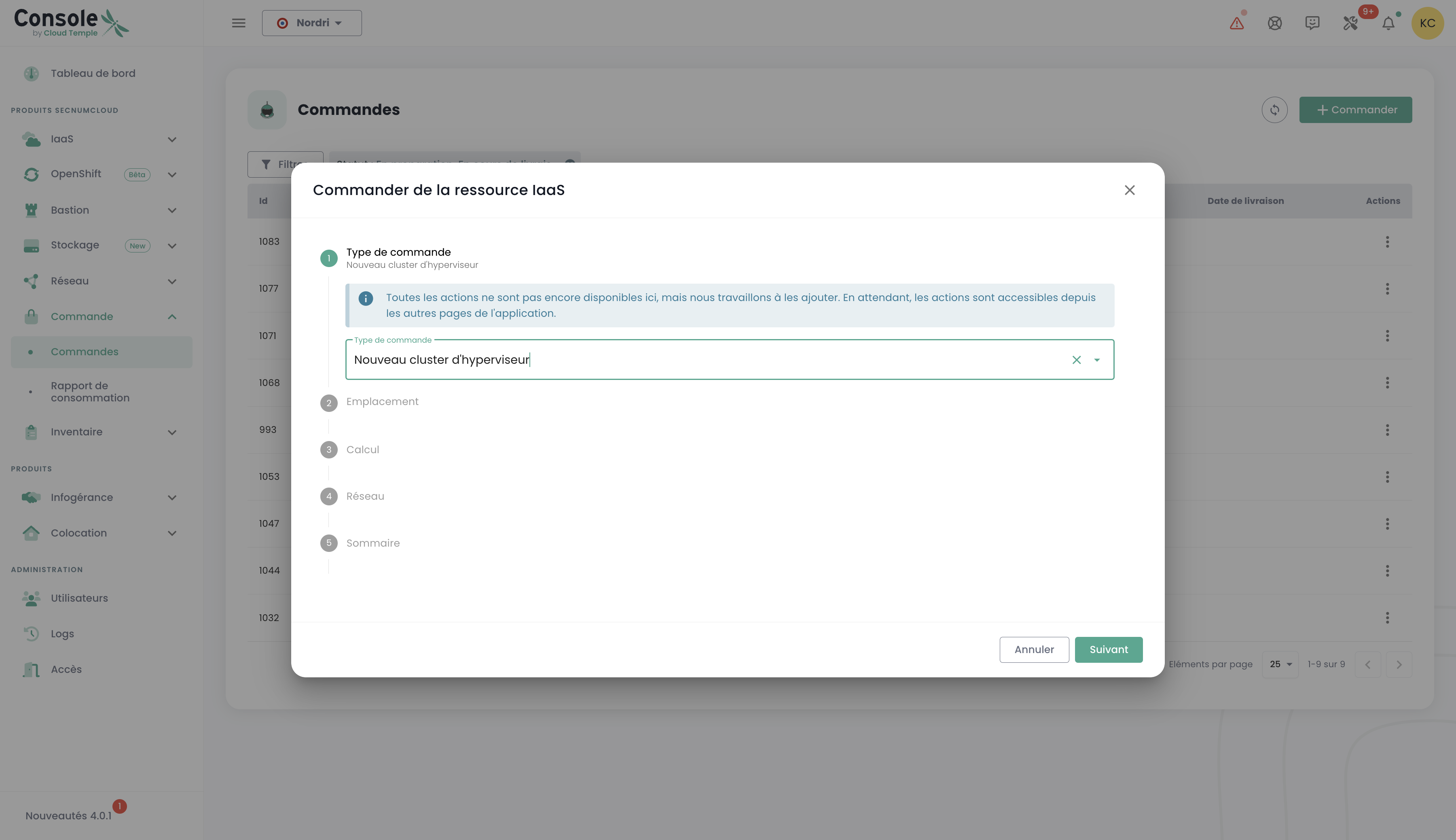

Déployer un nouveau cluster de calcul

Procédez à la commande d'un cluster d'hyperviseur en sélectionnant les options adaptées à vos besoins en matière de virtualisation. Définissez les caractéristiques clés telles que le nombre d'hyperviseurs, le type de cluster, la quantité de mémoire, ainsi que les ressources de calcul requises :

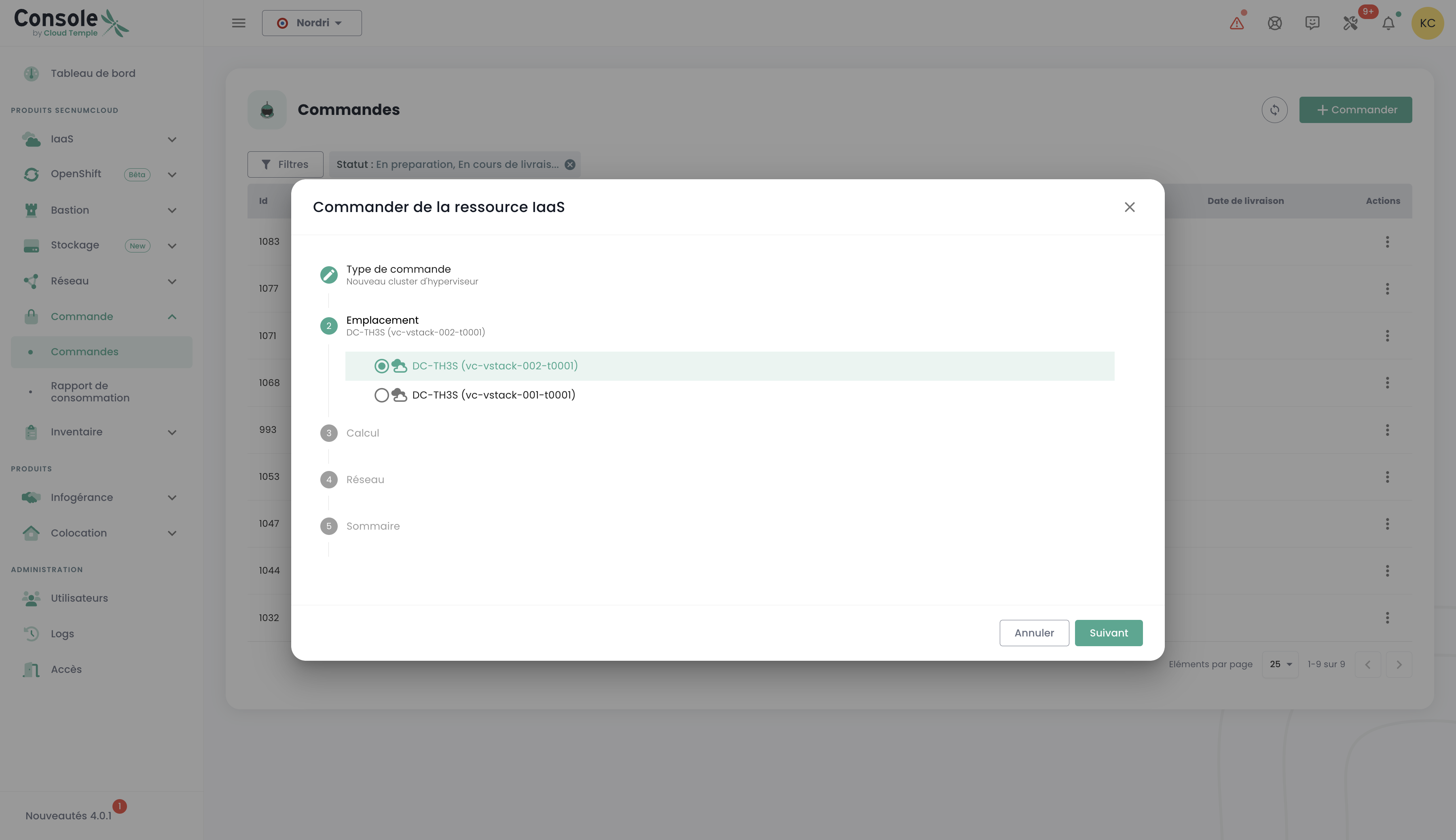

Sélectionnez la zone de disponibilité :

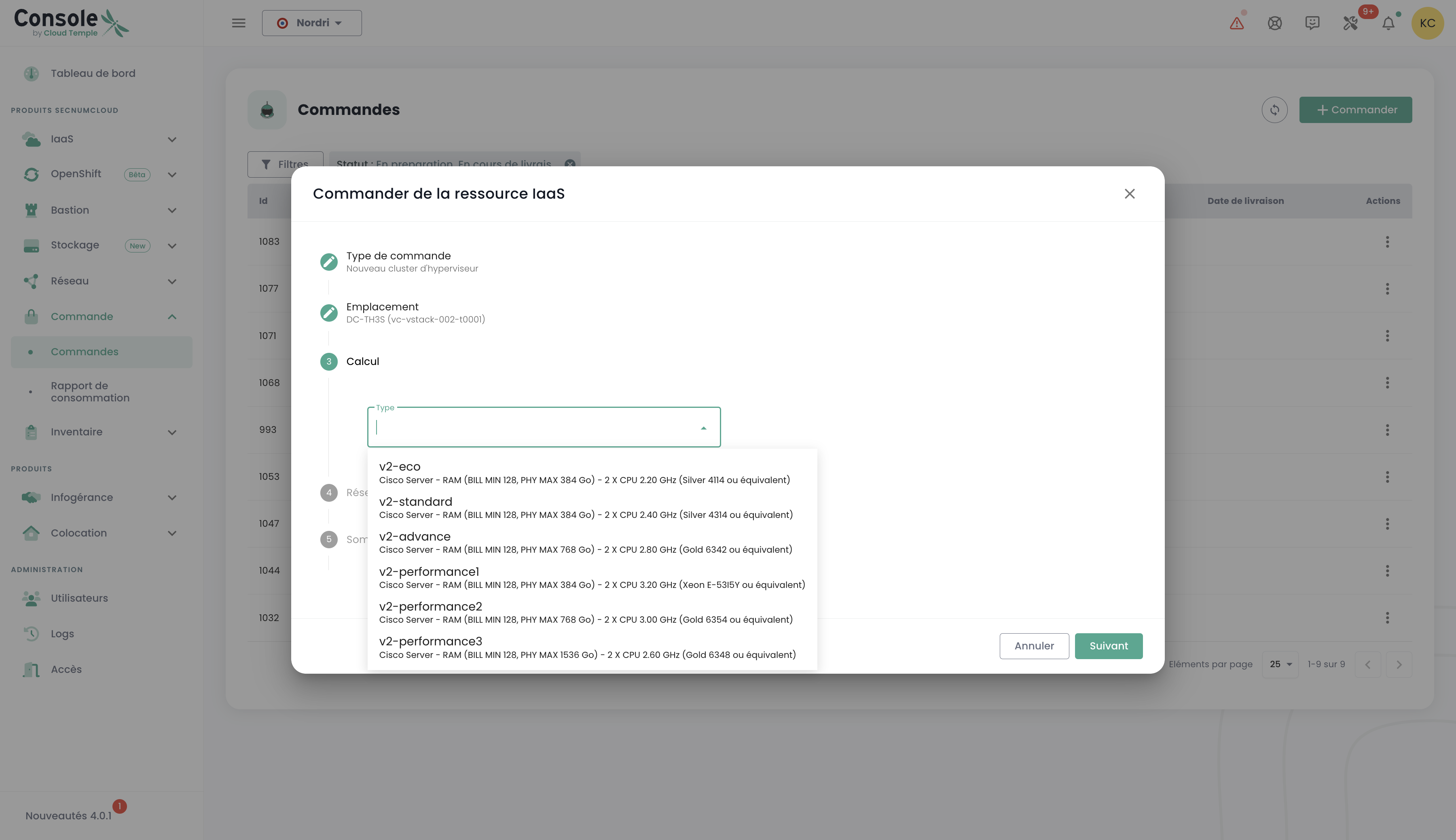

Choisissez le type de lame de calcul :

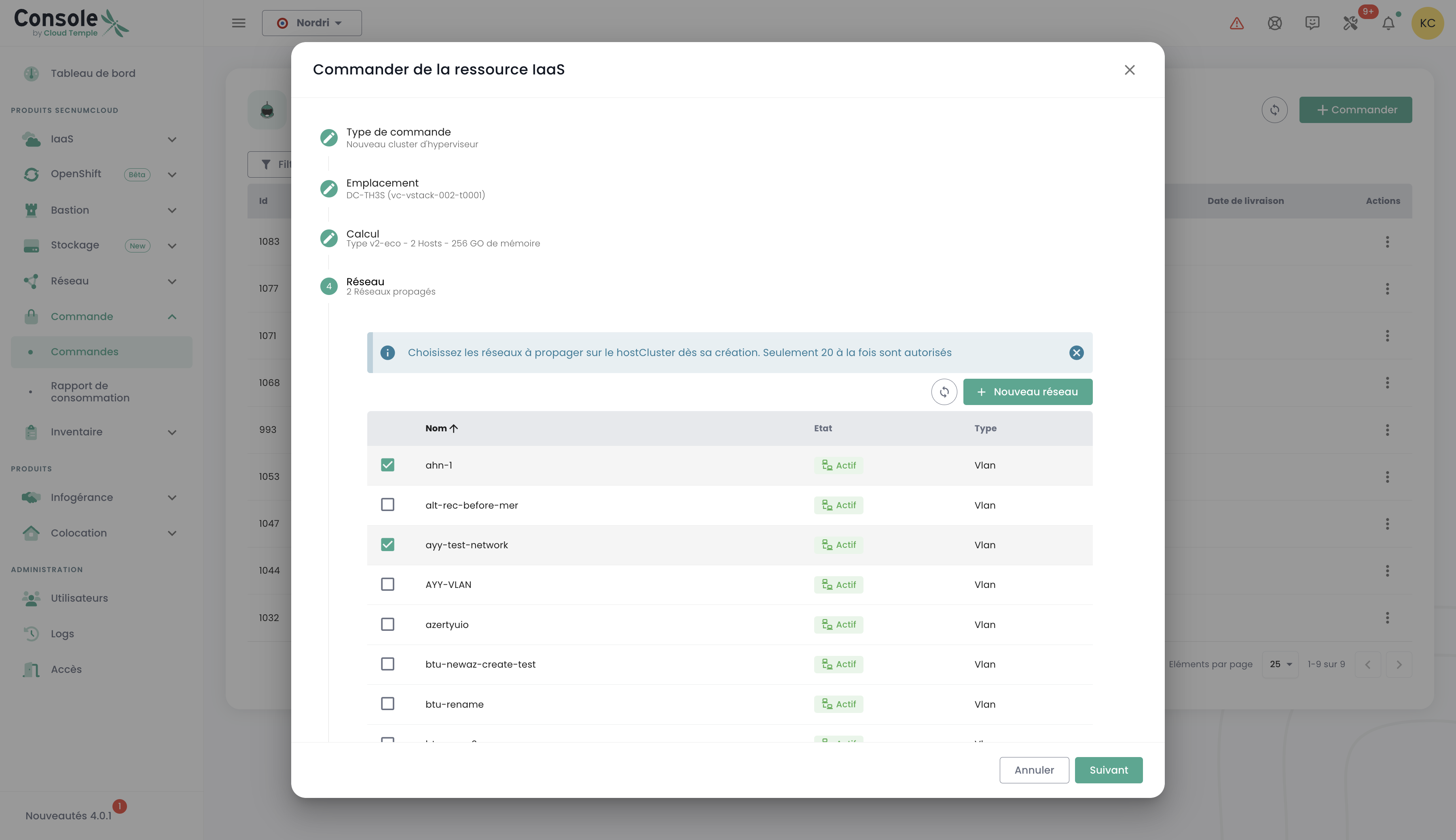

Vous avez ensuite la possibilité de sélectionner des réseaux déjà existants et de les propager, ou bien d'en créer de nouveaux directement à cette étape, selon les besoins de votre infrastructure. Notez que le nombre total de réseaux configurables est limité à un maximum de 20:

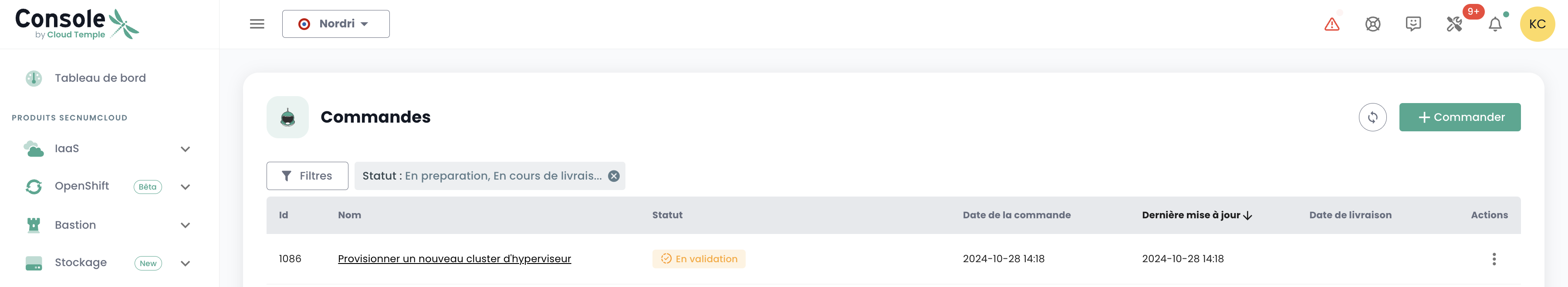

Vous obtenez ensuite un résumé des options séléctionnées avant de valider votre commande et vous pouvez ensuite visualiser votre commande en cours :

Déployer un nouveau cluster de stockage

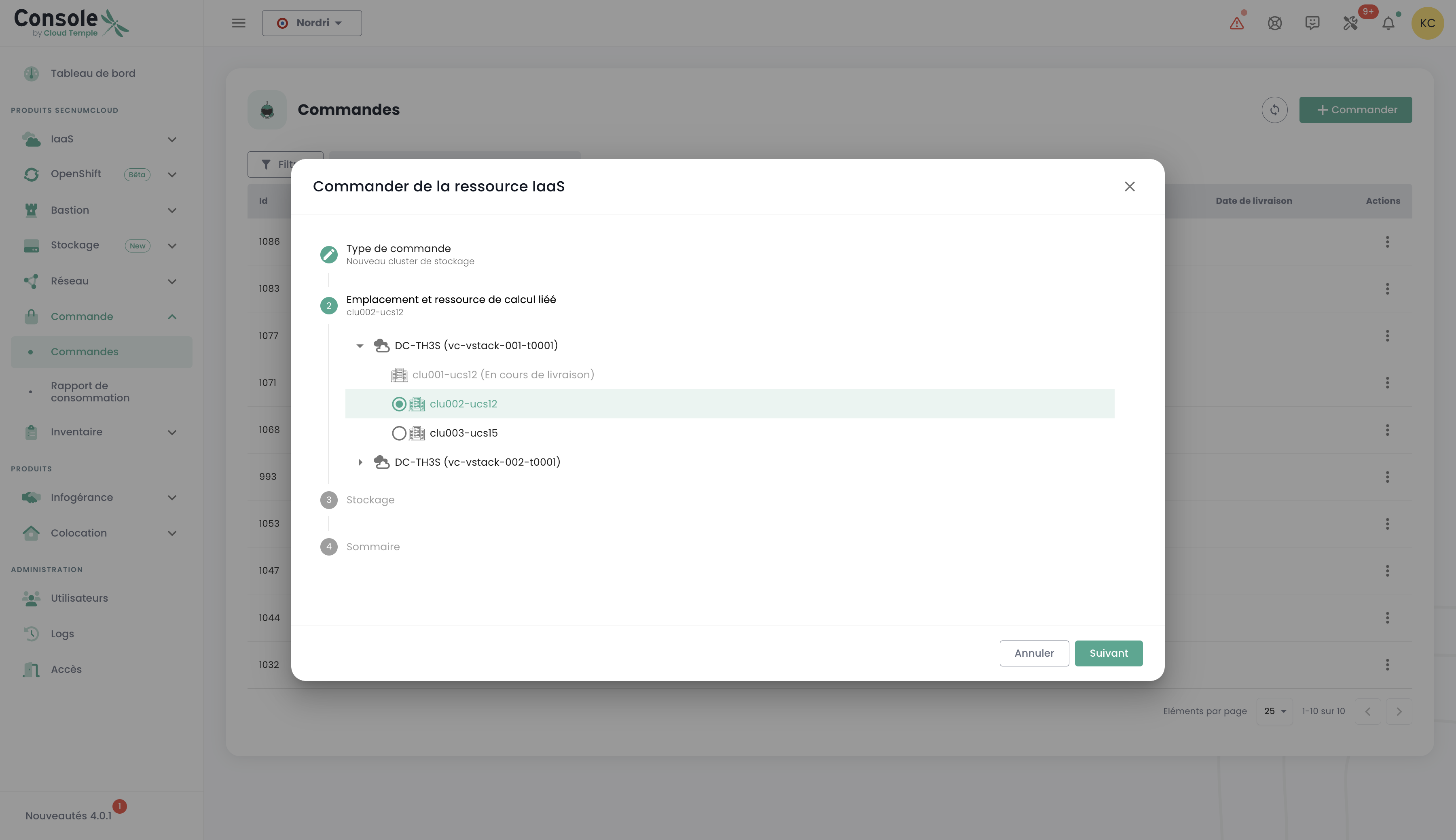

Dans le menu "commande", procédez à la commande d'un nouveau cluster de stockage pour votre environnement en sélectionnant les options qui correspondent à vos besoins en termes de capacité, de performance et de redondance. Sélectionnez l'emplacement :

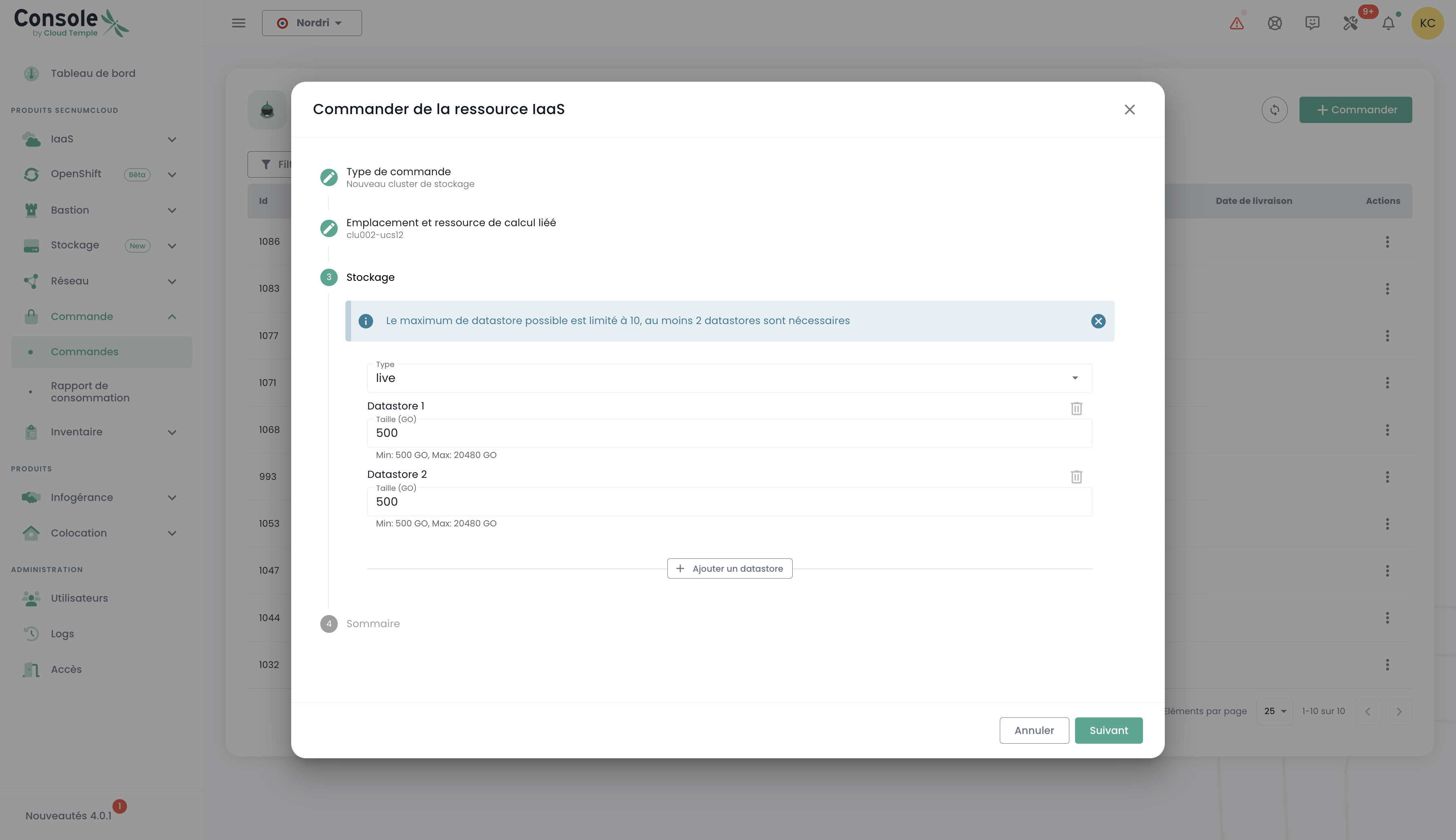

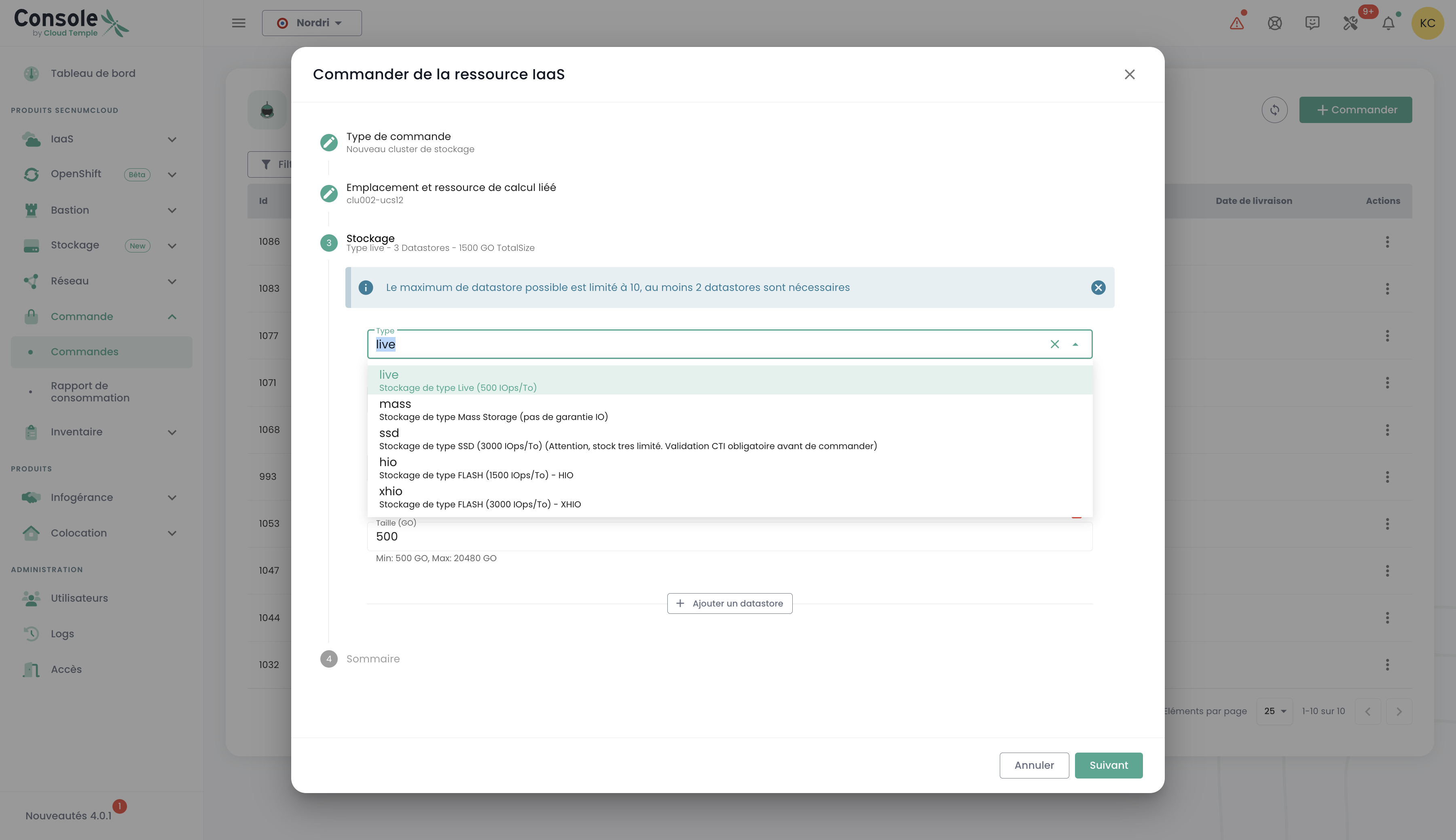

Définissez le nombre de datastores à provisionner dans le cluster ainsi que leur type, en respectant les limites suivantes : un minimum de 2 datastores et un maximum de 10 peuvent être configurés. Choisissez les types de datastores qui répondent le mieux à vos besoins en termes de performance, capacité et usage, afin d'optimiser le stockage de votre environnement :

Sélectionnez le type de stockage souhaité parmi les différentes options disponibles :

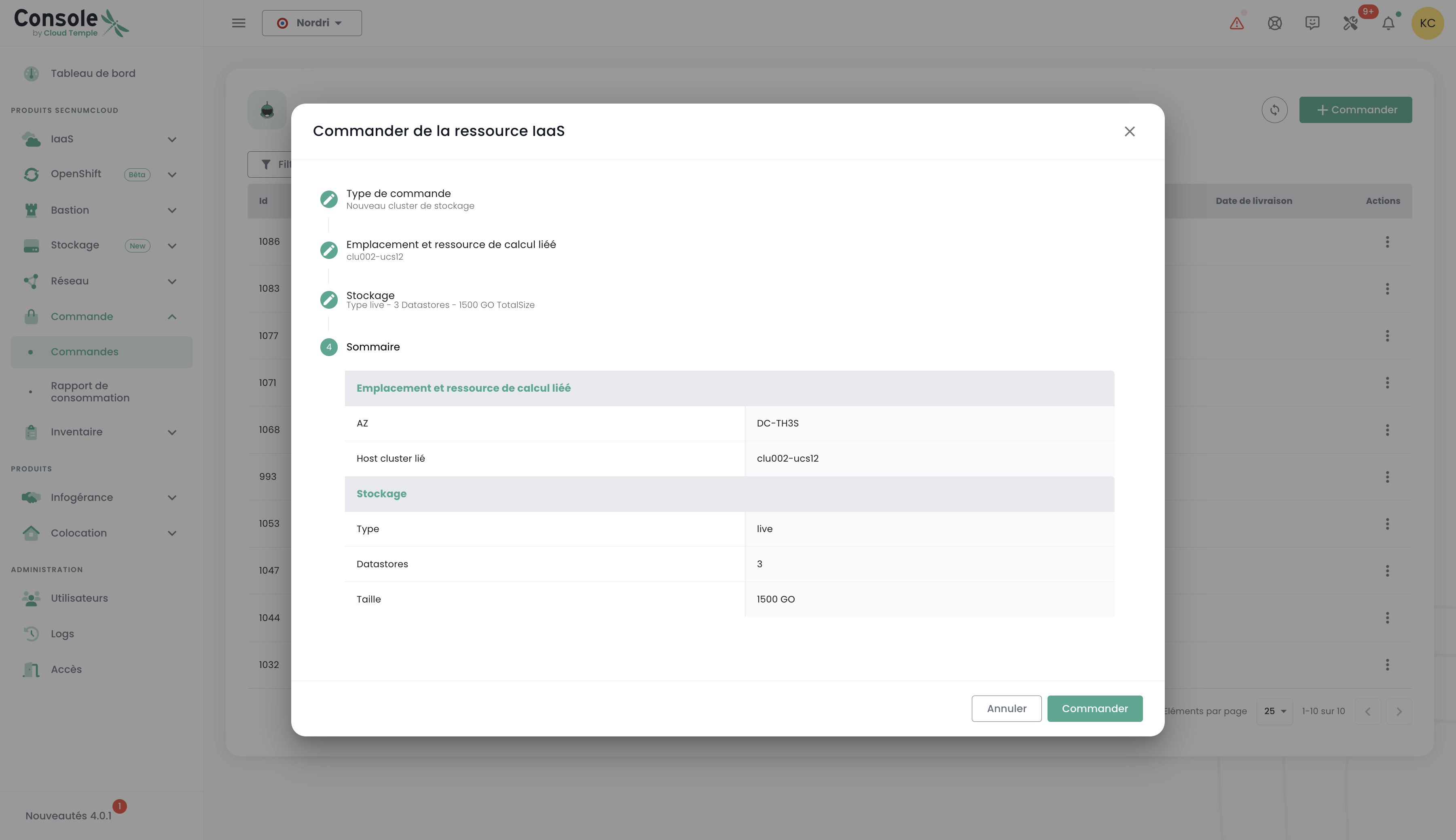

Vous accédez ensuite à un récapitulatif complet des options que vous avez sélectionnées, vous permettant de vérifier tous les paramètres avant de valider définitivement votre commande :

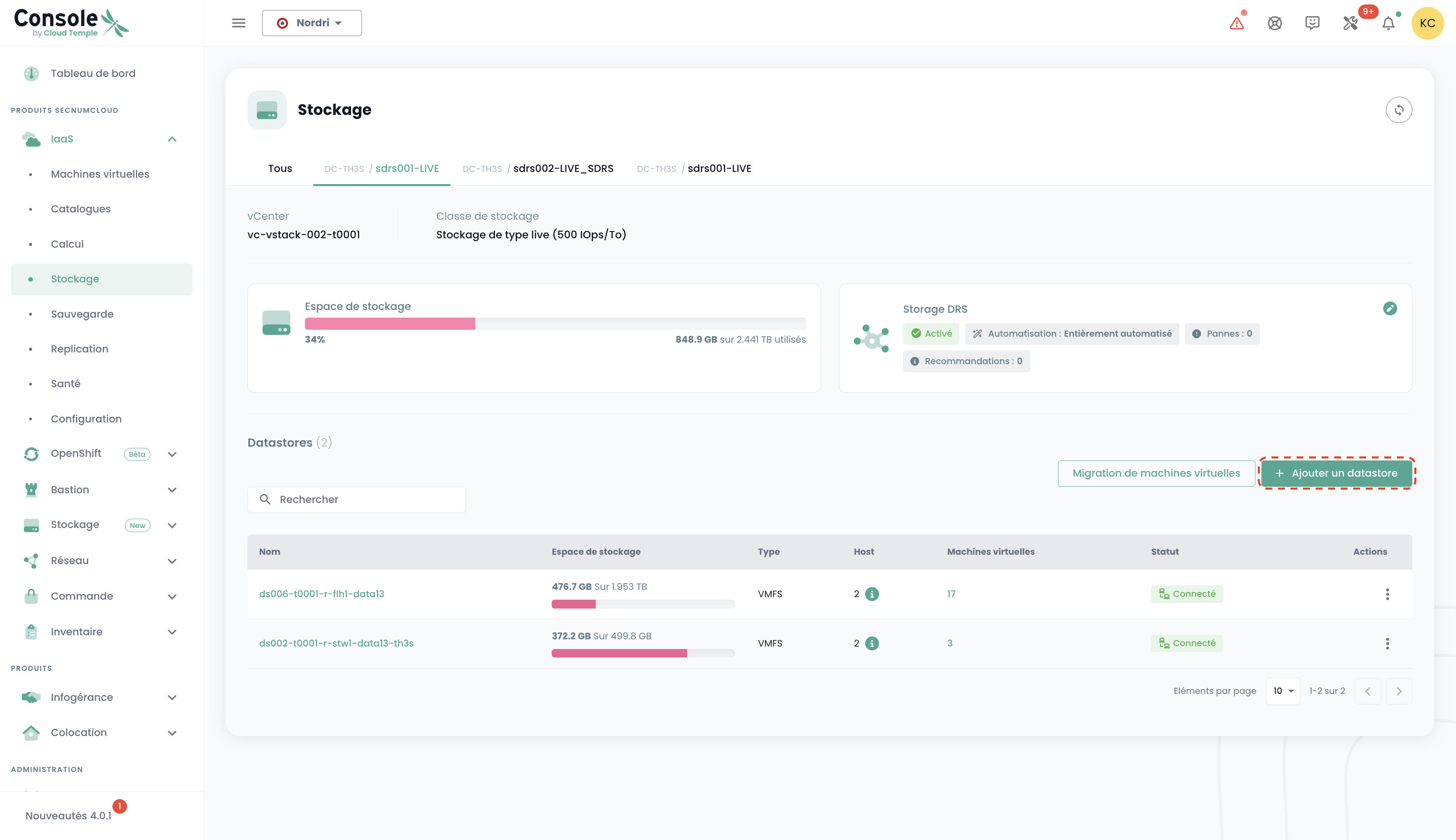

Déployer un nouveau datastore au sein d'un cluster SDRS VMware

Dans cet exemple, nous allons ajouter du stockage en mode bloc pour une infrastructure VMware. Pour ajouter un datastore supplémentaire dans votre cluster de stockage SDRS, allez dans le sous menu 'Infrastructure' puis 'VMWare'. Choisissez alors la stack vmware et la zone de disponibilité. Allez ensuite dans le sous menu 'Stockage'.

Choisissez le cluster SDRS correspondant aux caractéristiques de performance que vous souhaitez et cliquez sur le bouton 'Ajouter un datastore' qui se situe dans le tableau avec la liste des datastores.

nota :

- La taille de la plus petite LUN activable sur un cluster est de 500 Gio.

- Les performances d'un datastore vont de 500 IOPS/Tio en moyenne jusqu'à 15000 IOPS/Tio en moyenne. C'est un bridage logiciel réalisé au niveau des contrôleurs de stockage, soumis à un plafond matériel absolu de 30 000 IOPS et 1024 Mo/s maximum par LUN.

- La comptabilité du volume de disque consommé par votre organisation est la somme de toutes les LUNs sur l'ensemble des AZs utilisées.

- Les droits 'order' ainsi que 'compute' sont nécessaires au compte pour mener cette action.

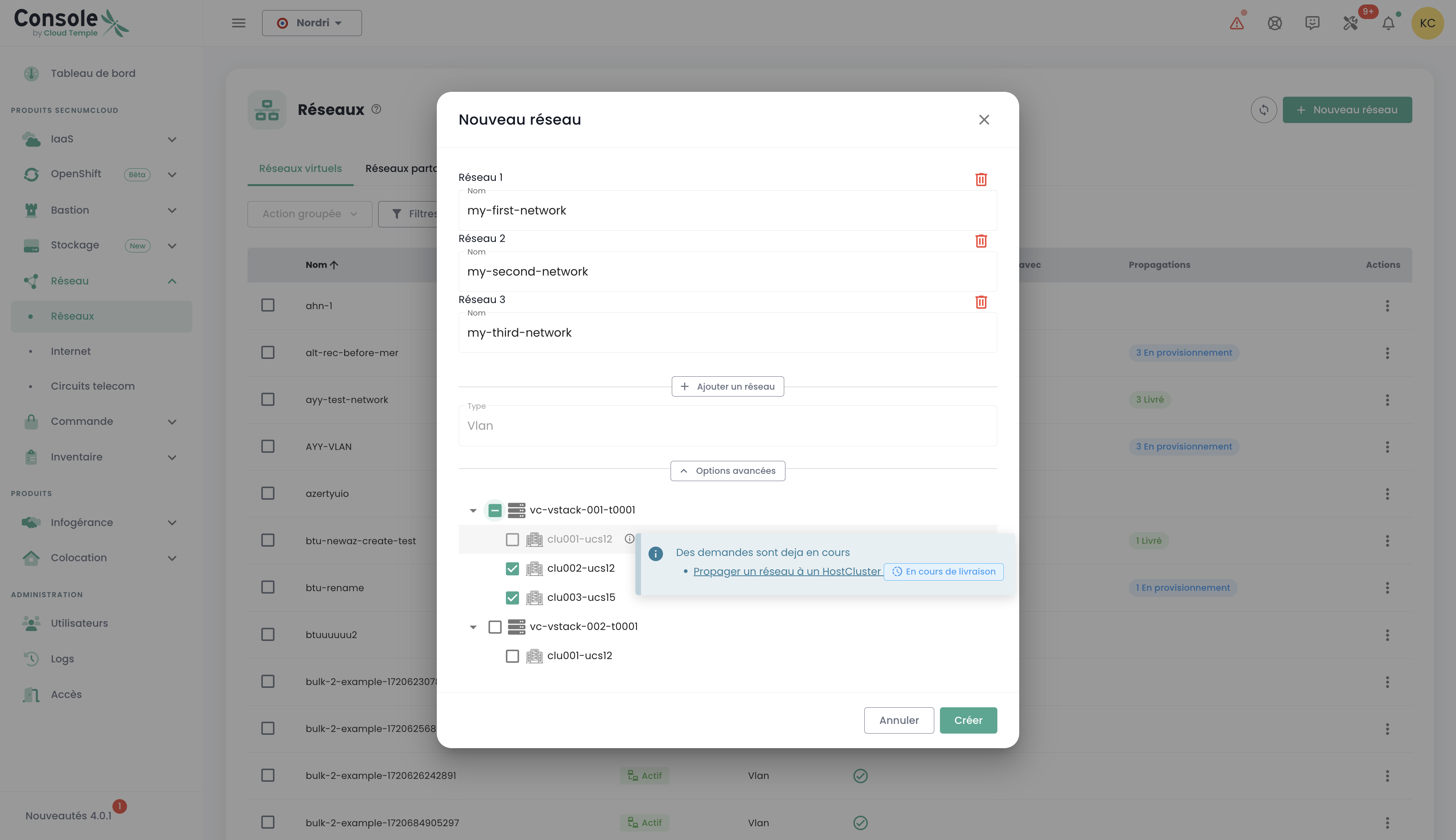

Commander de nouveaux réseaux

La technologie réseau utilisée sur l'infrastructure Cloud Temple est basée sur VPLS. Elle vous permet de bénéficier de réseaux de niveau 2 en continuité entre vos zones de disponibilité au sein d'une région. Il est aussi possible de partager des réseaux entre vos tenants et de les terminer en zone de hosting. Basiquement, vous pouvez imaginer un réseau Cloud Temple comme un vlan 802.1q disponible en tout point de votre tenant.

Les réseaux sur la plateforme Cloud Temple sont de niveau 2 (VLANs) basés sur la technologie VPLS (Virtual Private LAN Service). Cette technologie vous permet de bénéficier d'une continuité réseau entre vos zones de disponibilité au sein d'une région, avec des performances garanties :

- Latence intra-AZ : < 3 ms

- Latence inter-AZ : < 5 ms

Flexibilité des réseaux :

- Un réseau peut être partagé entre plusieurs clusters d'une même zone de disponibilité

- Un réseau peut être propagé entre plusieurs zones de disponibilité d'une même région

- Un réseau peut être partagé entre différents tenants de votre organisation

- Un réseau peut être terminé en zone de hosting pour vos équipements physiques

- Limite : Maximum de 20 réseaux par commande. Vous pouvez effectuer plusieurs commandes successives pour étendre ce nombre selon vos besoins

La commande d'un nouveau réseau et les décisions de partage entre vos tenants, sont réalisées dans le menu 'Réseau' du bandeau vert à gauche de l'écran. Les réseaux seront d'abord créés, puis une commande distincte sera générée pour les propager. Vous pouvez suivre l'avancement des commandes en cours en accédant à l'onglet "Commande" dans le menu, ou en cliquant sur les labels d'information qui vous redirigent vers les commandes actives ou en cours de traitement.

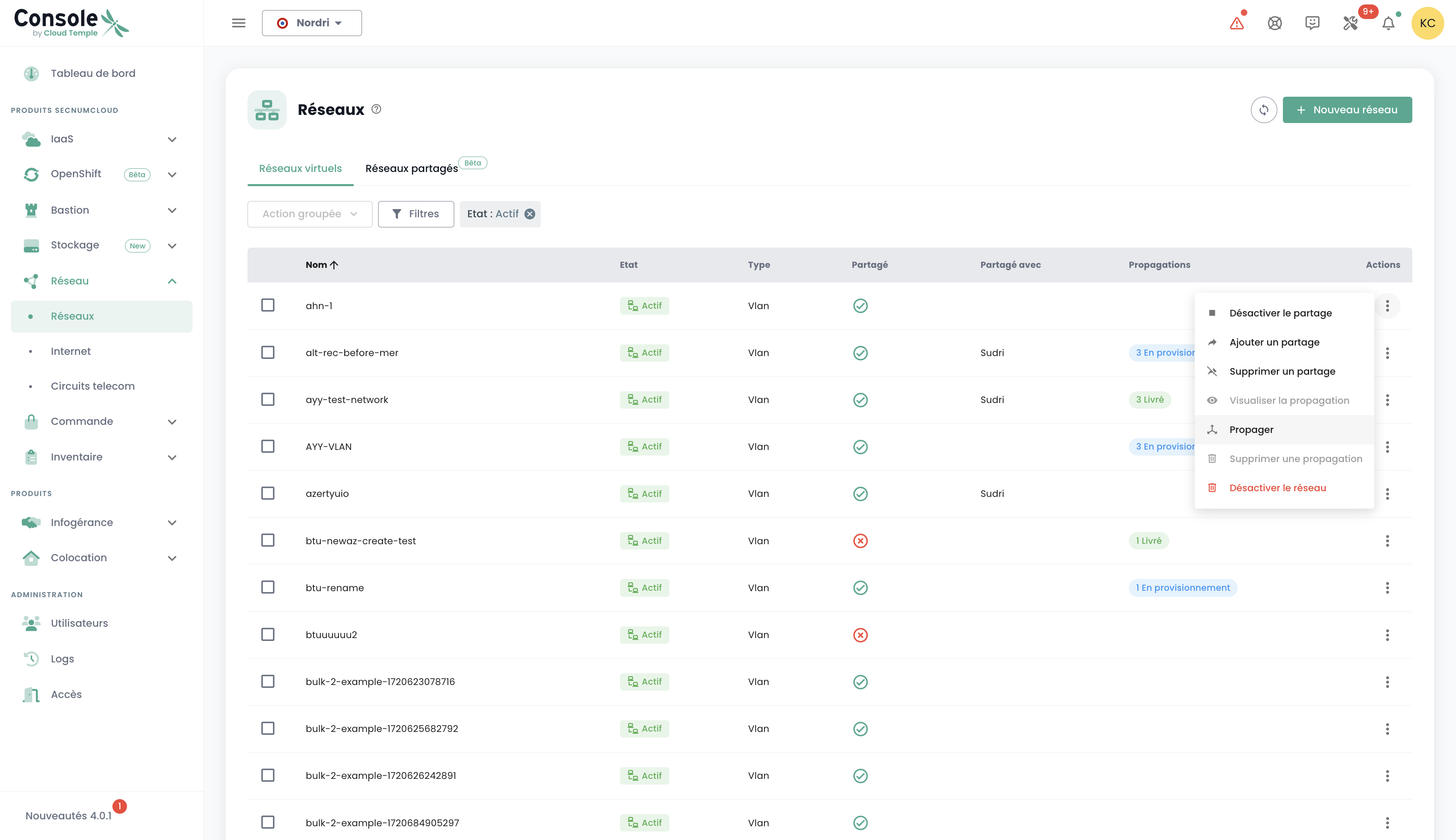

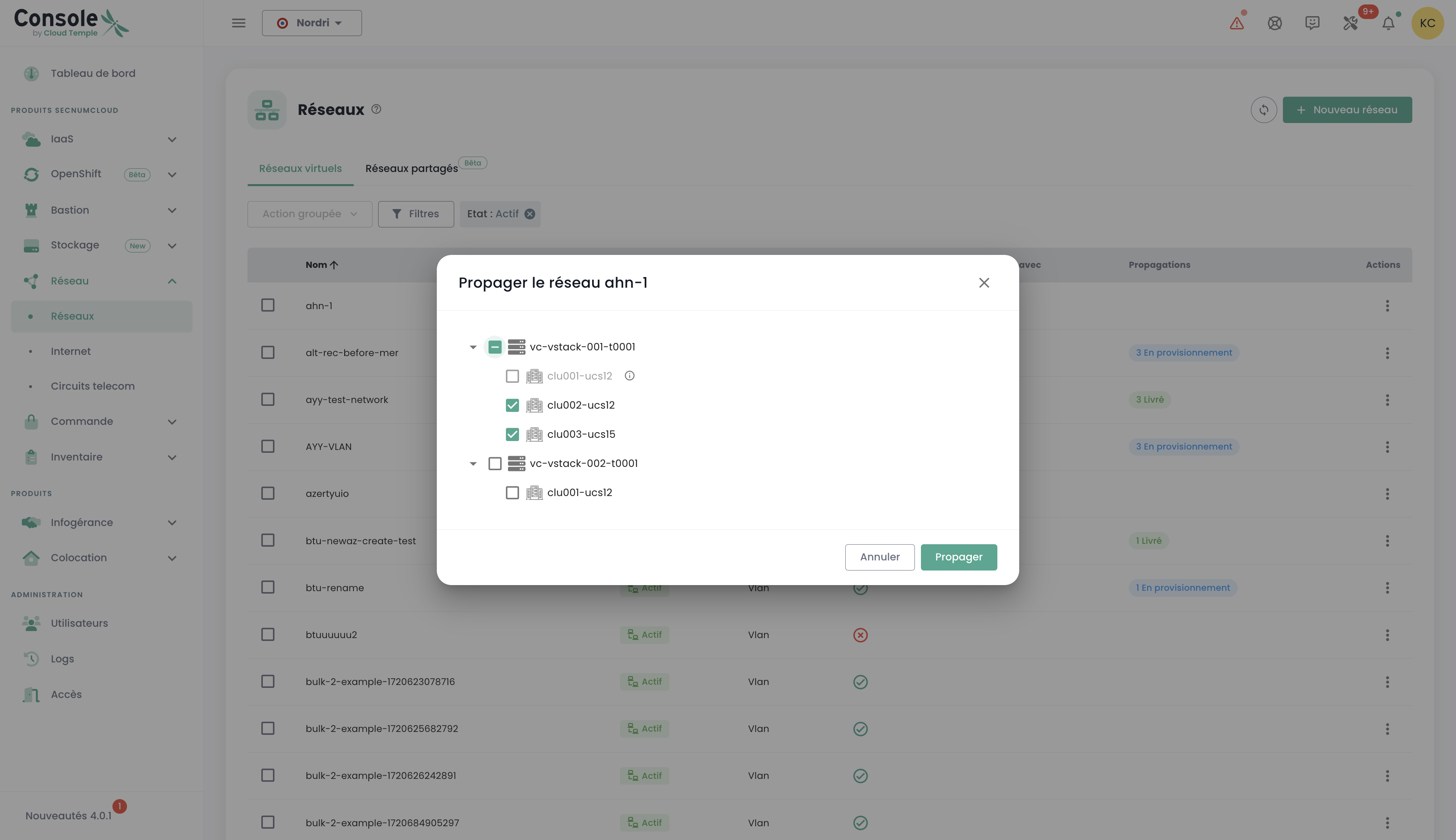

Il est également possible de propager des réseaux déjà existants ou de séparer les deux étapes, en commençant par la création du réseau, puis en procédant à la propagation ultérieurement selon vos besoins. L'option de propagation se trouve dans les options du réseau sélectionné :

Cliquez sur l'option "Propager" pour un réseau déjà existant, puis sélectionnez la cible de propagation souhaitée. Cette étape vous permet de définir l'emplacement ou les ressources sur lesquelles le réseau doit être propagé :

Désactivation d'un réseau

Un réseau peut également être désactivé si nécessaire. Cette option vous permet de mettre en pause temporairement l'accès ou l'utilisation du réseau sans le supprimer définitivement, offrant ainsi une flexibilité dans la gestion de votre infrastructure en fonction de vos besoins.

L'option de désactivation se trouve dans les options du réseau sélectionné. '

Ajouter des hyperviseurs supplémentaires à un cluster de calcul

Un cluster de calcul est un regroupement d'hyperviseurs qui doivent respecter les règles suivantes :

Pour les clusters VMware ESXi

Règles d'homogénéité :

- Tous les hôtes d'un cluster doivent être du même type de lame (ECO, STANDARD, ADVANCE, PERFORMANCE, etc.)

- Tous les hôtes appartiennent au même tenant et à la même zone de disponibilité

- Limite : Maximum de 32 hyperviseurs par cluster

Allocation mémoire :

- Chaque lame est livrée avec la totalité de la mémoire physique activée dès le départ

- Exemple : Un cluster de 3 lames STANDARD v3 (384 Go physiques chacune) = 3 × 384 Go = 1152 Go disponibles

- Recommandation : Ne pas dépasser 85% de consommation mémoire par lame pour éviter le mécanisme de compression VMware et le ballooning

Haute disponibilité :

- Minimum recommandé : 2 hyperviseurs par cluster pour bénéficier du SLA de 99,99%

- Activer la fonctionnalité VMware HA (High Availability) pour le redémarrage automatique des VMs en cas de défaillance d'un hôte

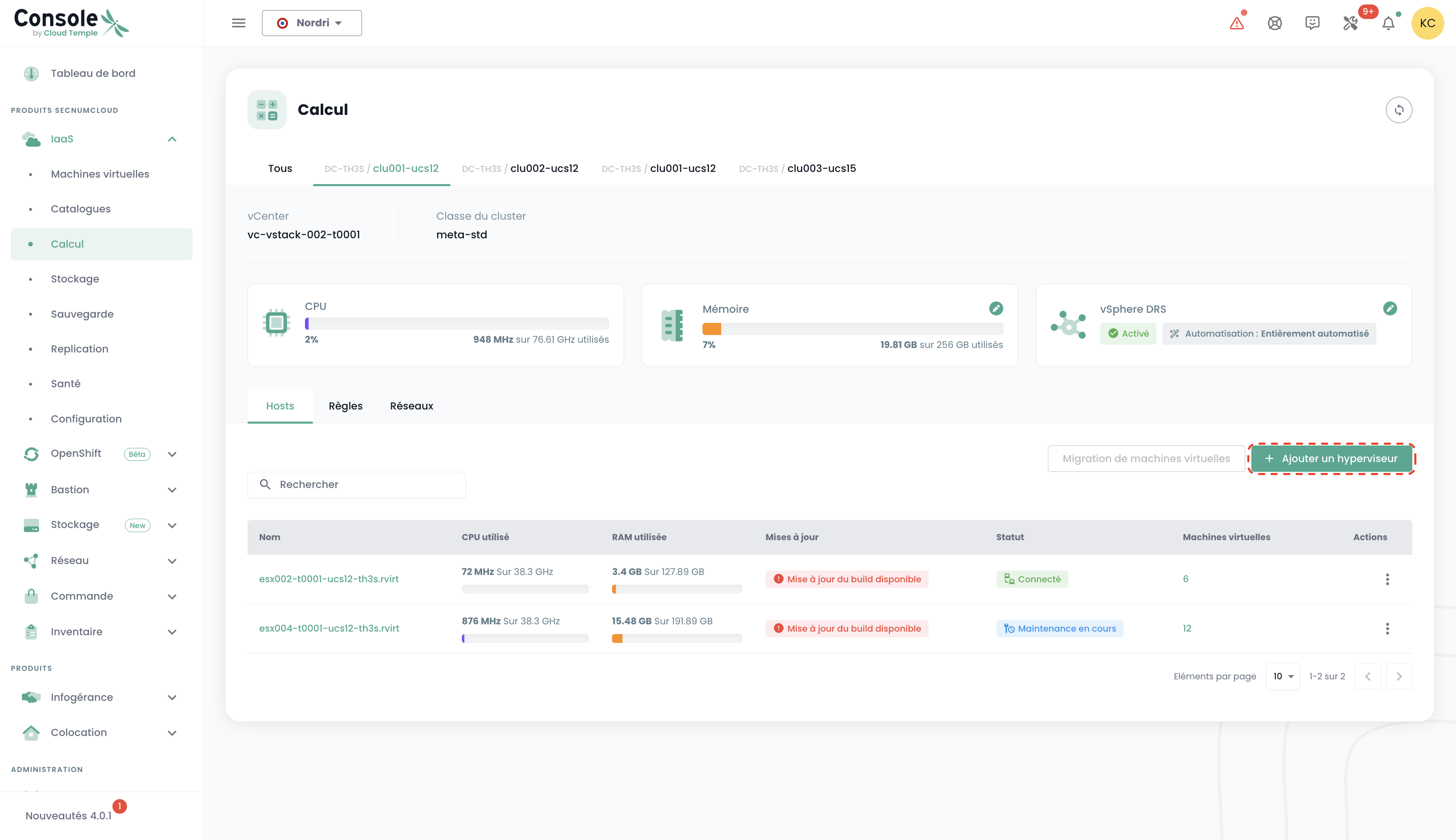

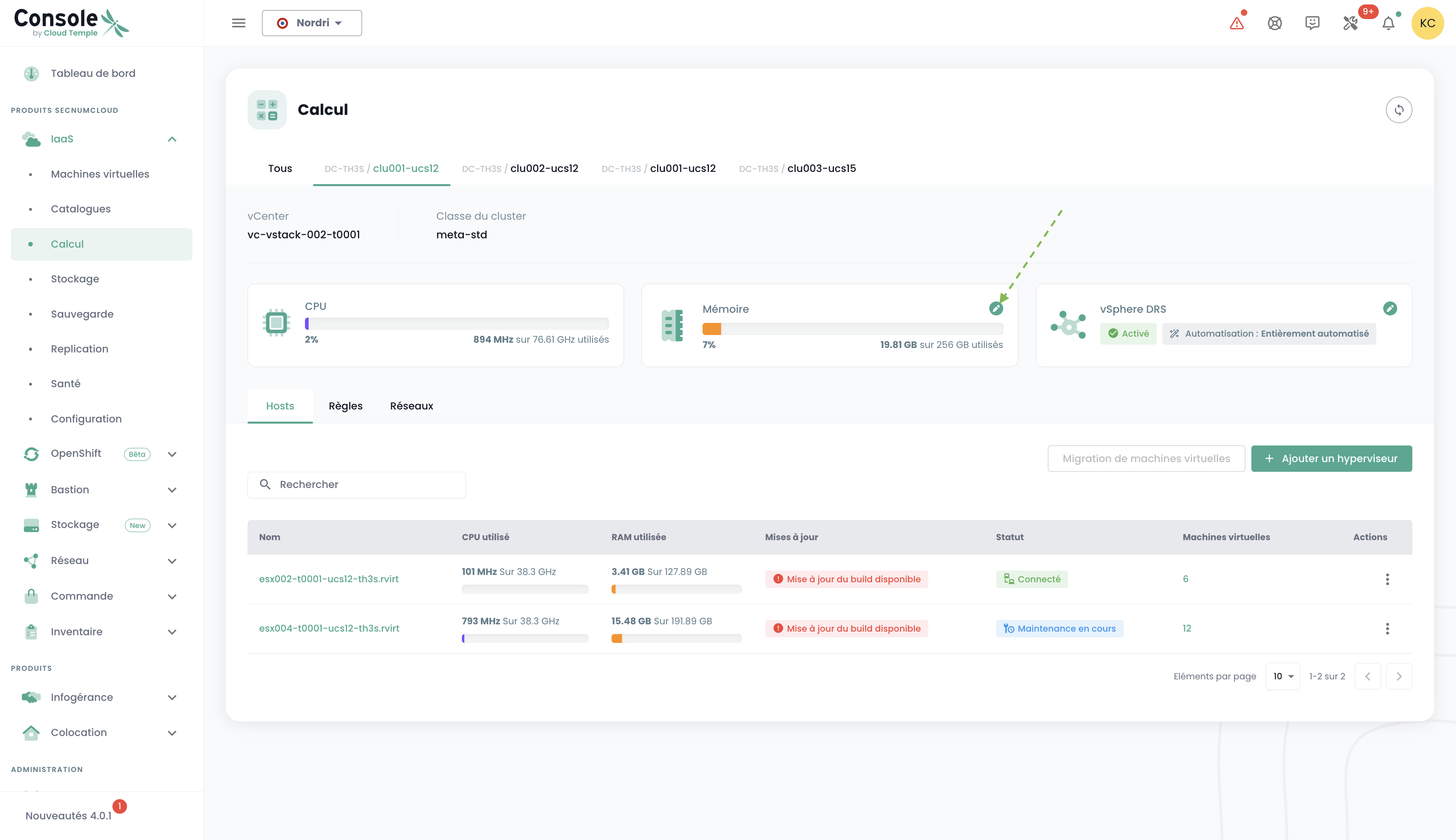

L'ajout d'hyperviseurs à un cluster de calcul se fait dans le menu 'IaaS' dans le bandeau vert à gauche de l'écran. Dans l'exemple suivant, nous allons ajouter du calcul sur un cluster d'hyperviseur utilisant la technologie VMware.

Allez dans le sous menu 'Infrastructure' puis 'VMWare'. Choisissez alors la stack vmware et la zone de disponibilité et le cluster de calcul. Dans cet exemple, il s'agit du 'clu001-ucs12'. Cliquez sur le bouton 'Ajouter un host' qui se situe dans le tableau avec la liste des hosts, en haut à droite.

nota :

- La configuration d'un cluster doit être homogène. Ainsi, il n'est pas permis de mixer les types d'hyperviseur au sein d'un cluster. Toutes les lames doivent être de même type.

- Les droits 'order' ainsi que 'compute' sont nécessaires au compte pour mener cette action.

Pour les clusters Open IaaS

Les clusters Open IaaS suivent des règles similaires en termes d'homogénéité et de haute disponibilité. La gestion des ressources de calcul s'effectue également via le menu 'OpenIaaS' avec les mêmes prérequis en termes de droits d'accès.

Ajouter de la ressource mémoire supplémentaire à un cluster de calcul

L'allocation de la mémoire sur les clusters de calcul fonctionne de la manière suivante :

Principe de l'allocation mémoire :

- Toutes les lames de calcul sont livrées avec le maximum physique de mémoire installée

- Une limitation logicielle est appliquée au niveau du cluster VMware pour correspondre à la RAM facturée

- Chaque lame dispose de la totalité de la mémoire physique activée au sein du cluster

Dimensionnement par cluster :

- Minimum : nombre d'hôtes × 128 Go de mémoire

- Maximum : nombre d'hôtes × quantité de mémoire physique de la lame

Exemple : Pour un cluster de trois hosts de type STANDARD v3 (384 Go physiques par lame)

- Mémoire totale disponible : 3 × 384 Go = 1152 Go

Recommandations importantes :

- Ne pas dépasser 85% de consommation mémoire moyenne par lame pour éviter le ballooning et la compression VMware

- Prévoir de l'espace disque pour les fichiers de swap (.VSWP) créés au démarrage de chaque VM (taille = mémoire de la VM)

Pour ajouter de la mémoire vive sur un cluster, il suffit de se rendre sur la configuration du cluster (comme pour l'ajout d'un hôte de calcul tel que précédemment vue) et de cliquer sur 'Modifier la mémoire'.

nota :

- Les machines sont livrées avec la totalité de la mémoire physique. Le débridage de la ressource mémoire n'est qu'une activation logicielle au niveau d'un cluster.

- Il n'est pas possible de modifier la quantité de mémoire physique d'un type de lame. Bien tenir compte de la capacité maximale d'une lame lors de la création d'un cluster.

- Les droits 'order' ainsi que 'compute' sont nécessaires au compte pour mener cette action.